尽管有关 GPT-3的传说四起,但它本身并不是 AGI。虽然在某些领域接近了人类能力(下棋或写作真的令人印象深刻) ,但它们好像做不出通用的智能,很多时候,GPT-3跟 AlphaGo 更像。 GPT-3(或者未来 GPT-x)在模仿人类方面表现的很不错,但它对过去的互动没有记忆,无法进行「多轮对话」,也无法跟踪目标或发挥更大的潜能。然而,语言建模与国际象棋或图像分类有很大的区别。自然语言本质上是对世界的信息进行编码,其表达方式比任何其他方式都要丰富得多。如果将语言模型嵌入到现有的AI模型,能否构建出原始的通用人工智能(AGI)呢?GPT-3解决的问题变多了,但只是堆了更多参数语言模型的目标仅仅是最大化模型在自然语言数据上的可能性, GPT-3使用的自回归意味着它会尽可能地预测下一个单词。通俗来讲,GPT-3更多地关注语法和拼写等文本差异,而不是语义和逻辑连贯性,而后者才是智能的关键,当自回归模型接近完美时,想要继续提升,唯一的

1750亿参数,GPT-3却并不「智能」

2020-08-19 13:35:05来源: 新浪科技

关注公众号

赞

你的鼓励是对作者的最大支持

- 苹果计划在2021年中推出“印度制造”iPhone 122020-08-19 13:27:15

- “有戏电影酒店”完成1.75亿元新融资2020-08-19 13:27:33

- 京东家庭医生上线,可在线预约2700家三甲医院挂号2020-08-19 13:31:31

- 香港恒指开盘跌0.03%,美团点评股价续刷新高2020-08-19 13:31:36

- TVB与优酷达成战略合作2020-08-19 13:35:50

- 华为芯片受限停产 凸显“中国芯”突围紧迫2020-08-19 13:35:05

- 可发电可通车的光伏路又来了 这次会有不一样结局吗?2020-08-19 13:35:05

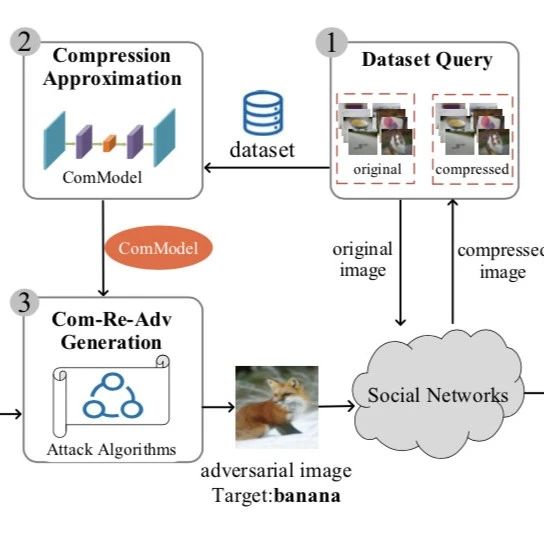

- 让人脸识别算法失灵,还能抵抗微信微博照片压缩!武大&Adobe提出抗压缩对抗新框架,…2020-08-19 13:35:05

- 马斯克蝉联美国CEO薪酬榜No.1,年入41亿,库克皮猜纳德拉加起来都没他高2020-08-19 13:35:05

- 马斯克的SpaceX又双叒叕融资了:喜提131亿,估值破3000亿2020-08-19 13:35:05